NTTは2026年4月22日、異なる大規模言語モデル(LLM)同士を連携させる際の障壁を取り除く推論技術を確立したと発表した。複数モデルの知識を統合・転用することで単体モデルを上回る推論精度を実現する。本成果は、同年4月23日からブラジル・リオデジャネイロで開催する深層学習分野の国際会議「International Conference on Learning Representations(ICLR) 2026」で発表する。

NTTは、異なる大規模言語モデル(LLM)同士を連携させる際の障壁を取り除く推論技術を確立した(図1)。複数モデルの知識を統合・転用することで単体モデルを上回る推論精度を実現する。

図1:異なる語彙を持つLLM同士でも、共通語彙を使って推論させることで、アンサンブルが可能になる(出典:NTT)

図1:異なる語彙を持つLLM同士でも、共通語彙を使って推論させることで、アンサンブルが可能になる(出典:NTT)拡大画像表示

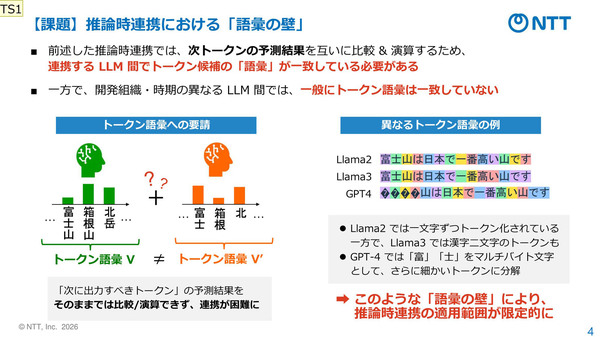

LLMは、文章を「トークン」と呼ぶ、単語や部分単語の単位に分割して処理する。推論時は、次に出力すべきトークンを確率で予測し、その結果を順に出力することで文章を生成する。各モデルはこのトークン候補の集合(トークン語彙)を数万から数十万規模で持っているが、異なるモデル間では構成が一致しないのが一般的である(図2)。

図2:複数モデルが推論時に連携するためにはトークン語彙は一致している必要がある(出典:NTT)

図2:複数モデルが推論時に連携するためにはトークン語彙は一致している必要がある(出典:NTT)拡大画像表示

例えば、「富士山」という文字列に対し、あるモデルは「富士山」を1つのトークンとして扱うが、別のモデルは「富士」「山」と2つに分割したり、「富」「士」「山」と1文字ずつに分割したりする。このトークン語彙の違いが、LLMを連携させるうえで障壁となっていた。

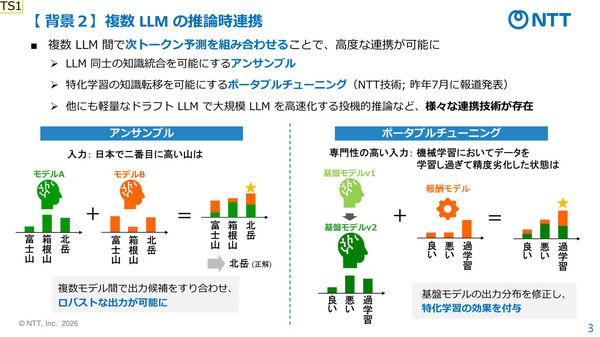

複数モデルを推論時に連携させる例として、複数モデルの予測結果を統合して精度を高める「アンサンブル」や、あるモデルで特化学習した知識を別モデルへ転用する「ポータブルチューニング」などがある(図3)。これらは、トークン語彙が一致しているモデル間でしか使えない。

図3:複数モデルを推論時に連携させる手法であるアンサンブルとポータブルチューニングの概要(出典:NTT)

図3:複数モデルを推論時に連携させる手法であるアンサンブルとポータブルチューニングの概要(出典:NTT)拡大画像表示

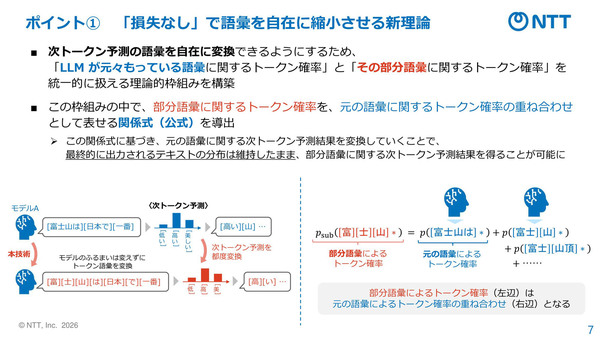

今回NTTが確立した技術は、推論中に各モデルの次トークン予測を、モデル間で共通する語彙だけを対象にリアルタイムで絞り込むものである(図4)。

図4:各モデルの次トークン予測を、モデル間で共通する語彙だけを対象に絞り込む。出力する文章全体の傾向は変わらない(出典:NTT)

図4:各モデルの次トークン予測を、モデル間で共通する語彙だけを対象に絞り込む。出力する文章全体の傾向は変わらない(出典:NTT)拡大画像表示

単純にトークン候補を削ると、出力品質は劣化する。例えば、「富士山」というトークンを語彙から除いた場合、そのトークンが選ばれるはずだった確率が行き場を失い、出力が変わってしまう。これに対してNTTは、除外するトークンに割り当てられていた確率を「富士」「山」など、それを構成する細かいトークンへと分配する。出力する文章全体の傾向は変わらないという。

計算効率の面でも工夫を施した。過去に計算済みの予測結果をキャッシュとして再利用することと、確率がほぼゼロの候補トークンの計算を省略することを組み合わせ、通常の推論と同程度の計算コストで推論できるようにした。

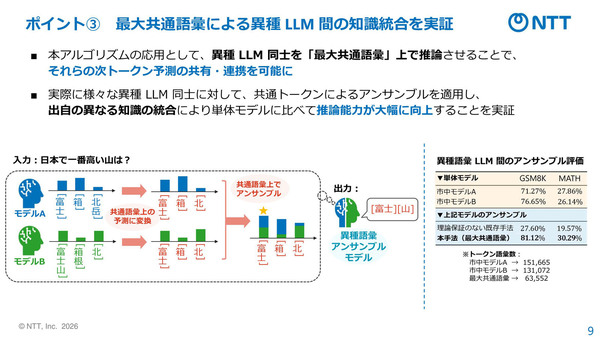

確立した技術を使うと、語彙が異なる複数のモデルに対して「最大共通語彙」、すなわち1文字単位まで細分化せずに両モデルが共通して持つトークンの最大集合を導出し、全モデルをその共通語彙上で推論させることができる。実験では、語彙数が約15万と約13万の2モデルに対して、最大共通語彙は約6万4000トークンになった。

共通語彙でアンサンブルを適用した実験では、数学タスクにおいてモデルA単体の27.86%、モデルB単体の26.14%に対し、今回の手法によるアンサンブルで30.29%と精度が向上することを確認した(図5)。既存のアンサンブル手法は19.57%にとどまった。

図5:共通トークンによるアンサンブルでタスクの精度が向上した(出典:NTT)

図5:共通トークンによるアンサンブルでタスクの精度が向上した(出典:NTT)拡大画像表示

- 業務システム 2027年4月強制適用へ待ったなし、施行迫る「新リース会計基準」対応の勘所【IT Leaders特別編集版】

- 生成AI/AIエージェント 成否のカギは「データ基盤」に─生成AI時代のデータマネジメント【IT Leaders特別編集号】

- フィジカルAI AI/ロボット─Society 5.0に向けた社会実装が広がる【DIGITAL X/IT Leaders特別編集号】

- メールセキュリティ 導入のみならず運用時の“ポリシー上げ”が肝心[DMARC導入&運用の極意]【IT Leaders特別編集号】

- ゼロトラスト戦略 ランサムウェア、AI詐欺…最新脅威に抗するデジタル免疫力を![前提のゼロトラスト、不断のサイバーハイジーン]【IT Leaders特別編集号】

-

-

-

-

-

-

AIの真価は「今この瞬間」の感知にある。「Data Streaming Platform」で実現する「AI Ready Data」を解説

-

-

-

-

VDIの導入コストを抑制! コストコンシャスなエンタープライズクラスの仮想デスクトップ「Parallels RAS」とは

-

AI時代の“基幹インフラ”へ──NEC・NOT A HOTEL・DeNAが語るZoomを核にしたコミュニケーション変革とAI活用法

-

加速するZoomの進化、エージェント型AIでコミュニケーションの全領域を変革─「Zoom主催リアルイベント Zoomtopia On the Road Japan」レポート

-

14年ぶりに到来したチャンスをどう活かす?企業価値向上とセキュリティ強化・運用効率化をもたらす自社だけの“ドメイン”とは

-

-

-

-

生成AIからAgentic AIへ―HCLSoftware CRO Rajiv Shesh氏に聞く、企業価値創造の課題に応える「X-D-Oフレームワーク」

-

-

-

「プラグアンドゲイン・アプローチ」がプロセス変革のゲームチェンジャー。業務プロセスの持続的な改善を後押しする「SAP Signavio」

-

BPMとプロセスマイニングで継続的なプロセス改善を行う仕組みを構築、NTTデータ イントラマートがすすめる変革のアプローチ

-