富士通研究所と米Fujitsu Laboratories of America(米国富士通研究所)は2019年10月15日、米Carnegie Mellon University School of Computer Science(カーネギーメロン大学コンピューターサイエンス学部)と共同で、こまやかな表情の変化を高精度に検出可能なAI表情認識技術を開発したと発表した。

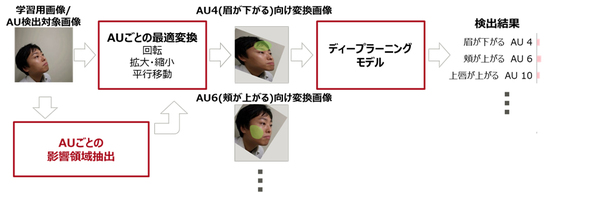

富士通研究所と米国富士通研究所は、AU(解剖学的知見に基づき、顔面の各筋肉に基づいた動きの単位として定義したもの)ごとに最適化した画像変換を用いることで、小規模な学習データでも高精度にAUを検出する技術を開発した(図1)。普段の動作で生じる様々な顔の向きや角度においても、苦笑いや喜びの驚き、戸惑いを感じた際などのこまやかな表情変化を高精度に検出できる。

図1:開発した技術の概要(出典:富士通研究所)

図1:開発した技術の概要(出典:富士通研究所)拡大画像表示

本技術により、表情データセット「FERA2017」(Facial Expression Recognition and Analysis Challenge 2017)に対して、81%と高い検出精度を実現した。また、FERA2017のベンチマーク指標による比較でも、開発技術が最先端の既存研究よりも高い精度であることを確認した。今後、富士通研究所と米国富士通研究所は、遠隔会議支援や社員のエンゲージメント測定、ドライバーの運転の様子の見守りなど、様々な利用シーンでの実用化を目指す。

これまでも、表情筋の動きから表情変化を捉える手法は使われてきた。しかし、様々な動作の中の顔から検出モデルを学習するためには膨大なデータが必要になるため、精度に問題があった。今回、例えば斜めを向いている顔に対しても、顔を正面から撮影した基準となる画像に近づくように補正を行う技術によって、小規模なデータで検出モデルを学習することができるようにした。

開発した技術の特徴の1つは、顔を正面から撮影した基準となる画像に近づける入力画像変換処理によって、少ない学習データでAUを検出できること。

様々な角度・大きさ・位置で撮影された顔の画像に対して、顔を正面から撮影した基準の画像に見え方が近づくように、回転や拡大・縮小、平行移動などの変換処理を行う。これにより、小規模な学習データでもAUを検出できる。

開発した技術のもう1つの特徴は、AU検出に影響する領域をAUごとに分析することによって、高い検出精度を実現したこと。

変換処理においては、画像における顔の複数の特徴点が、基準となる正面の顔の画像における特徴点の位置に近づくように変換を行うが、特徴点を顔の部位のどこに設定するかによって、回転や拡大・縮小、平行移動の量が変わってくる。例えば、特徴点を目の周辺と設定して回転処理を実行すると、目の周辺は基準の顔の画像に近い位置となりますが、口などの部位は基準の顔の画像とずれた位置になる。

このため、撮影した顔の画像から、AU検出に影響の大きな領域を分析し、その領域周辺の特徴点が、基準の顔の画像の特徴点の位置に近づくように、回転や拡大・縮小、平行移動の量を調整する。基準の顔の画像の見え方に近づける変換処理を、AUごとに調整することで、高精度にAUを検出する。

- 業務システム 2027年4月強制適用へ待ったなし、施行迫る「新リース会計基準」対応の勘所【IT Leaders特別編集版】

- 生成AI/AIエージェント 成否のカギは「データ基盤」に─生成AI時代のデータマネジメント【IT Leaders特別編集号】

- フィジカルAI AI/ロボット─Society 5.0に向けた社会実装が広がる【DIGITAL X/IT Leaders特別編集号】

- メールセキュリティ 導入のみならず運用時の“ポリシー上げ”が肝心[DMARC導入&運用の極意]【IT Leaders特別編集号】

- ゼロトラスト戦略 ランサムウェア、AI詐欺…最新脅威に抗するデジタル免疫力を![前提のゼロトラスト、不断のサイバーハイジーン]【IT Leaders特別編集号】

-

-

-

-

-

-

-

-

-

-

AIの真価は「今この瞬間」の感知にある。「Data Streaming Platform」で実現する「AI Ready Data」を解説

-

-

-

-

VDIの導入コストを抑制! コストコンシャスなエンタープライズクラスの仮想デスクトップ「Parallels RAS」とは

-

AI時代の“基幹インフラ”へ──NEC・NOT A HOTEL・DeNAが語るZoomを核にしたコミュニケーション変革とAI活用法

-

加速するZoomの進化、エージェント型AIでコミュニケーションの全領域を変革─「Zoom主催リアルイベント Zoomtopia On the Road Japan」レポート

-

14年ぶりに到来したチャンスをどう活かす?企業価値向上とセキュリティ強化・運用効率化をもたらす自社だけの“ドメイン”とは

-

-

-

-

生成AIからAgentic AIへ―HCLSoftware CRO Rajiv Shesh氏に聞く、企業価値創造の課題に応える「X-D-Oフレームワーク」

-

-

-

「プラグアンドゲイン・アプローチ」がプロセス変革のゲームチェンジャー。業務プロセスの持続的な改善を後押しする「SAP Signavio」

-

BPMとプロセスマイニングで継続的なプロセス改善を行う仕組みを構築、NTTデータ イントラマートがすすめる変革のアプローチ

-