[市場動向]

NEDOとOKI、AI学習時の量子化値を柔軟に割り当てる低ビット量子化技術「LCQ」を開発

2021年6月21日(月)日川 佳三(IT Leaders編集部)

国立研究開発法人 新エネルギー・産業技術総合開発機構(NEDO)と沖電気工業(OKI)は2021年6月21日、AIの学習時に、その時々に必要十分なビット値をパラメータに割り当てることで計算量を減らす技術「LCQ(Learnable Companding Quantization)」を開発したと発表した。同技術によって、エッジ領域での高精細な画像認識など、演算リソースが限られたデバイスにAIを実装しやすくなる。

新エネルギー・産業技術総合開発機構(NEDO)と沖電気工業(OKI)は、計算効率が高いAI処理手法を開発する取り組みにおいて、AIの学習時に、推論時の認識精度を維持するのに必要十分なビット値を割り当てる技術「LCQ」を開発した(図1)。

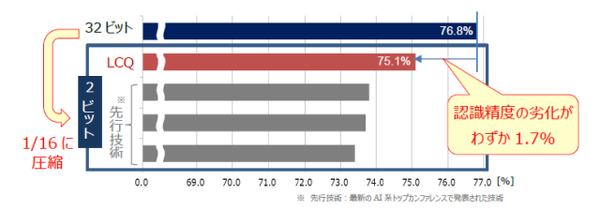

図1:LCQによる量子化時の認識精度(出典:新エネルギー・産業技術総合開発機構、沖電気工業)

図1:LCQによる量子化時の認識精度(出典:新エネルギー・産業技術総合開発機構、沖電気工業)拡大画像表示

ディープラーニングネットワーク(DNN)の性能を測る画像認識のベンチマークにおいて、高精度モデルを32ビットから2ビットへと16分の1に圧縮した場合、従来の技術では認識精度に約3%の劣化が生じてしまうのに対して、LCQでは1.7%と小さく抑えることに成功した。

両組織によると、DNNの精度向上には大量の演算リソースや電力が必要なため、エッジ領域でAIを活用するための策として、演算を低ビットに量子化(演算の入出力を細かい値から粗い値に近似することで演算負荷を低減)し、FPGAなど専用のハードウェア上で実行してきたという。

従来の技術では、量子化する前の値に対する量子化後の値(量子化値)をあらかじめ固定値として割り当てていた。このため、2ビットなどの超低ビットへ圧縮すると、固定値との誤差によって認識精度が劣化し、実用化への障壁となっていた。

こうした経緯から、両組織は、DNNの学習時に、推論時の認識精度を維持するのに最も適した低ビット量子化値を割り当てる技術としてLCQを開発した。音声符号化分野でよく扱われる非線形量子化技術「Companding」を応用し、DNNの学習における量子化値を、柔軟に割り当てられるようにしている。

LCQでは、DNNの誤差勾配に基づいて圧縮関数と伸張関数を学習し、これを反映した量子化処理を行う。これにより、非線形な量子化関数が構築され、最適な量子化値を割り当てられるようになる。低ビット量子化時の課題となっていた認識精度の劣化を抑制できるだけでなく、2ビットなど超低ビット量子化で高い効果を発揮できるとしている。

- 業務システム 2027年4月強制適用へ待ったなし、施行迫る「新リース会計基準」対応の勘所【IT Leaders特別編集版】

- 生成AI/AIエージェント 成否のカギは「データ基盤」に─生成AI時代のデータマネジメント【IT Leaders特別編集号】

- フィジカルAI AI/ロボット─Society 5.0に向けた社会実装が広がる【DIGITAL X/IT Leaders特別編集号】

- メールセキュリティ 導入のみならず運用時の“ポリシー上げ”が肝心[DMARC導入&運用の極意]【IT Leaders特別編集号】

- ゼロトラスト戦略 ランサムウェア、AI詐欺…最新脅威に抗するデジタル免疫力を![前提のゼロトラスト、不断のサイバーハイジーン]【IT Leaders特別編集号】

-

-

-

-

-

-

-

-

-

-

AIの真価は「今この瞬間」の感知にある。「Data Streaming Platform」で実現する「AI Ready Data」を解説

-

-

-

-

VDIの導入コストを抑制! コストコンシャスなエンタープライズクラスの仮想デスクトップ「Parallels RAS」とは

-

AI時代の“基幹インフラ”へ──NEC・NOT A HOTEL・DeNAが語るZoomを核にしたコミュニケーション変革とAI活用法

-

加速するZoomの進化、エージェント型AIでコミュニケーションの全領域を変革─「Zoom主催リアルイベント Zoomtopia On the Road Japan」レポート

-

14年ぶりに到来したチャンスをどう活かす?企業価値向上とセキュリティ強化・運用効率化をもたらす自社だけの“ドメイン”とは

-

-

-

-

生成AIからAgentic AIへ―HCLSoftware CRO Rajiv Shesh氏に聞く、企業価値創造の課題に応える「X-D-Oフレームワーク」

-

-

-

「プラグアンドゲイン・アプローチ」がプロセス変革のゲームチェンジャー。業務プロセスの持続的な改善を後押しする「SAP Signavio」

-

BPMとプロセスマイニングで継続的なプロセス改善を行う仕組みを構築、NTTデータ イントラマートがすすめる変革のアプローチ

-