富士通研究所は2021年1月13日、映像による人の行動認識において、箱を開けて物品を取り出すなど、複数の関節が連動して動くような複雑な行動についても、隣り合う各関節の位置や接続関係を用い、ディープラーニング(深層学習)を用いて高精度に認識できる技術を開発したと発表した。同技術は、行動認識分野における骨格データを用いた世界標準のベンチマークにおいて、隣り合う関節の情報を用いない従来技術の正解率を大きく上回り、世界最高精度を達成したという。工場での作業手順の確認や公共機関における危険行動の検知などに活用し、安全性やサービスの改善を図る。

近年のAI技術の進歩に伴い、工場での作業手順の確認や公共機関における危険行動の検知などを目的に、深層学習によって映像から人の行動を認識できるようになりつつある。一般に、AIによる人の映像認識では、手や肘、肩などの骨格の各関節位置の時間的変化を特徴量として抽出し、立つ・座るなどの簡単な行動パターンと紐づけて認識していた。

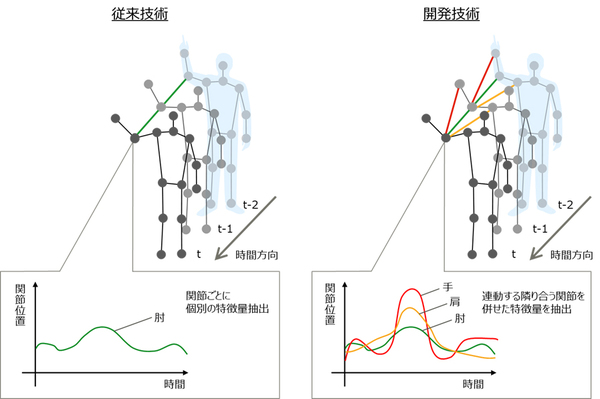

富士通研究所は、映像による人の行動認識において、箱を開けて物品を取り出すなど、複数の関節が連動して動くような複雑な行動についても、隣り合う各関節の位置や接続関係を用い、ディープラーニング(深層学習)を使って高精度に認識できる技術を開発した。富士通研究所はこれを「時系列行動認識技術」と呼んでいる(図1)。

図1:富士通研究所が開発した、人の複雑な行動を高精度に認識するAI技術の概要(出典:富士通研究所)

図1:富士通研究所が開発した、人の複雑な行動を高精度に認識するAI技術の概要(出典:富士通研究所)拡大画像表示

開梱作業などの複雑な行動では、腕の曲げ伸ばしに伴い、手や肘、肩の関節が連動して動く。今回、関節位置をノード(頂点)として、人体の構造に基づいて隣り合う関節を結んだエッジからなるグラフを採用し、グラフ構造の畳み込み演算を行うグラフ畳み込みニューラルネットワークの新たなAIモデルを開発した。

同モデルを、あらかじめ関節の時系列データを用いて学習することで、隣り合う関節との接続強度(重み)を最適化し、行動の認識に有効な接続関係を獲得できる。従来技術では、関節ごとの個別の特徴を正確に捉える必要があったが、学習済みのAIモデルでは、連動する隣り合う関節をあわせた特徴量を抽出でき、複雑な行動に対する高精度な認識を可能にした。

同技術を、行動認識分野における骨格データを用いた世界標準のベンチマークで評価したところ、公開データセットにおける、立つ・座るなどの単純な行動では、隣り合う関節の情報を用いない従来技術と同等の正解率を保つことができた。開梱作業・物を投げるなどの複雑な行動では、正解率が大きく向上し、全体として7%以上を上回って、世界一の認識精度を達成したという。

富士通研究所は今後、同技術で得た複雑な行動を認識できるAIモデルを、富士通研究所の行動認識AI「行動分析技術 Actlyzer」の基本動作100種類に追加して、複雑な行動を高精度に認識するモデルを短時間で構築可能にする。また、2021年度中の実用化を目指し、様々な業務の現場の改善や安全な社会の構築に向けた課題解決を支援するとしている。

- 業務システム 2027年4月強制適用へ待ったなし、施行迫る「新リース会計基準」対応の勘所【IT Leaders特別編集版】

- 生成AI/AIエージェント 成否のカギは「データ基盤」に─生成AI時代のデータマネジメント【IT Leaders特別編集号】

- フィジカルAI AI/ロボット─Society 5.0に向けた社会実装が広がる【DIGITAL X/IT Leaders特別編集号】

- メールセキュリティ 導入のみならず運用時の“ポリシー上げ”が肝心[DMARC導入&運用の極意]【IT Leaders特別編集号】

- ゼロトラスト戦略 ランサムウェア、AI詐欺…最新脅威に抗するデジタル免疫力を![前提のゼロトラスト、不断のサイバーハイジーン]【IT Leaders特別編集号】

-

-

-

-

-

-

-

-

-

-

-

-

AIの真価は「今この瞬間」の感知にある。「Data Streaming Platform」で実現する「AI Ready Data」を解説

-

-

-

-

VDIの導入コストを抑制! コストコンシャスなエンタープライズクラスの仮想デスクトップ「Parallels RAS」とは

-

AI時代の“基幹インフラ”へ──NEC・NOT A HOTEL・DeNAが語るZoomを核にしたコミュニケーション変革とAI活用法

-

加速するZoomの進化、エージェント型AIでコミュニケーションの全領域を変革─「Zoom主催リアルイベント Zoomtopia On the Road Japan」レポート

-

14年ぶりに到来したチャンスをどう活かす?企業価値向上とセキュリティ強化・運用効率化をもたらす自社だけの“ドメイン”とは

-

-

-

-

生成AIからAgentic AIへ―HCLSoftware CRO Rajiv Shesh氏に聞く、企業価値創造の課題に応える「X-D-Oフレームワーク」

-

-

-

「プラグアンドゲイン・アプローチ」がプロセス変革のゲームチェンジャー。業務プロセスの持続的な改善を後押しする「SAP Signavio」

-

BPMとプロセスマイニングで継続的なプロセス改善を行う仕組みを構築、NTTデータ イントラマートがすすめる変革のアプローチ

-