日立製作所は2021年12月24日、「説明可能なAI」の技術を強化したと発表した。内容が複雑なブラックボックス型のAIを、判断基準が明確なAI(単純な予測式)に変換する技術を新たに開発した。同技術の一部を、日立グループにおける製品出荷前の自動検査ラインに適用したところ、熟練者不足の解消や、検査速度の向上といった効果を確認したという。

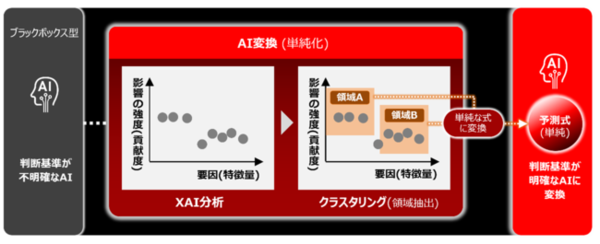

日立製作所は、「説明可能なAI」(Explainable AI:XAI)の技術を強化した。内容が複雑なブラックボックス型のAIを、判断基準が明確なAI(単純な予測式)に変換する技術を新たに開発した(図1)。同技術の一部を、日立グループにおける製品出荷前の自動検査ラインに適用したところ、熟練者不足の解消や、検査速度の向上といった効果を確認した。

図1:内容が複雑なブラックボックス型のAIを、判断基準が明確なAI(単純な予測式)に変換する技術を開発した(出典:日立製作所)

図1:内容が複雑なブラックボックス型のAIを、判断基準が明確なAI(単純な予測式)に変換する技術を開発した(出典:日立製作所)拡大画像表示

従来のブラックボックス型AIは、予測精度を高めるために、複雑な数式で構成している。判断基準が不明確であるため、未知のデータに対して意図しない予測結果を導く不安やリスクがある。一方、今回開発した技術を用いると、人が理解できる単純な予測式に変換することにより、明確な判断基準の下で予測結果を提示する。出力した予測式の調整も可能である。

同社はこれまでも、説明可能なAIを活用したサービスを提供し、有用性を検証してきた(関連記事:日立、「説明可能なAI」を活用した「AI導入・運用支援サービス」を開始、現場の納得感を獲得)。検証によると、想定できない予測結果をAIが出力する場合、ユーザーはAIを信頼できず、対策に多くの時間を取られてしまうことが分かった。こうした経緯から今回の技術を開発した。

開発した新技術の流れを説明している。まずは、従来のXAI分析技術を使い、入力データに対し、要因(特徴量)が予測値に及ぼす影響の強さ(貢献度)を算出する。次に、特徴量が変化しても予測値への貢献度が一定である入力データの領域をクラスタリング技術によって抽出する。

抽出した入力データ領域においては、特徴量は予測値に影響を与えない。このため、この領域で判断基準を単純化できることを期待して、AIを単純な予測式に変換する。このような処理をすべての入力データ領域で繰り返し、全領域を単純な予測式に変換する。

予測式は調整可、式を適用する領域の変更や、式の変更が可能

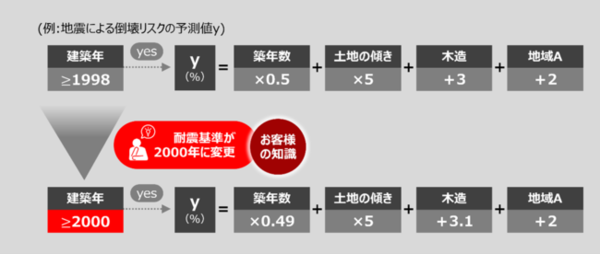

得られた予測式を調整する機能も備える(図2)。入力データ領域を分割する際の境界値を、ユーザーの知識に合わせて調整する。例えば、「耐震基準が2000年に変更されたので、1998年ではなく2000年の前後で判断基準が替わるようにしたい」という調整が可能である。

図2:得られた予測式を調整する機能も備える。入力データ領域を分割する際の境界値を、ユーザーの知識に合わせて調整できるほか、より単純な形の式へと変形できる(出典:日立製作所)

図2:得られた予測式を調整する機能も備える。入力データ領域を分割する際の境界値を、ユーザーの知識に合わせて調整できるほか、より単純な形の式へと変形できる(出典:日立製作所)拡大画像表示

予測精度よりも予測式の単純さを優先する場合は、より単純な形の式を指定すればよい。例えば、「築年数×0.5」+「土地の傾き×5」+「木造なら+3」+「地域Aなら+2」という4つの変数が複雑だと考える場合は、影響が小さな最後の要素「地域Aなら+2」を削除して変数を3つにする、といった調整が効く。

- 業務システム 2027年4月強制適用へ待ったなし、施行迫る「新リース会計基準」対応の勘所【IT Leaders特別編集版】

- 生成AI/AIエージェント 成否のカギは「データ基盤」に─生成AI時代のデータマネジメント【IT Leaders特別編集号】

- フィジカルAI AI/ロボット─Society 5.0に向けた社会実装が広がる【DIGITAL X/IT Leaders特別編集号】

- メールセキュリティ 導入のみならず運用時の“ポリシー上げ”が肝心[DMARC導入&運用の極意]【IT Leaders特別編集号】

- ゼロトラスト戦略 ランサムウェア、AI詐欺…最新脅威に抗するデジタル免疫力を![前提のゼロトラスト、不断のサイバーハイジーン]【IT Leaders特別編集号】

-

-

-

-

-

-

-

-

-

-

-

-

AIの真価は「今この瞬間」の感知にある。「Data Streaming Platform」で実現する「AI Ready Data」を解説

-

-

-

-

VDIの導入コストを抑制! コストコンシャスなエンタープライズクラスの仮想デスクトップ「Parallels RAS」とは

-

AI時代の“基幹インフラ”へ──NEC・NOT A HOTEL・DeNAが語るZoomを核にしたコミュニケーション変革とAI活用法

-

加速するZoomの進化、エージェント型AIでコミュニケーションの全領域を変革─「Zoom主催リアルイベント Zoomtopia On the Road Japan」レポート

-

14年ぶりに到来したチャンスをどう活かす?企業価値向上とセキュリティ強化・運用効率化をもたらす自社だけの“ドメイン”とは

-

-

-

-

生成AIからAgentic AIへ―HCLSoftware CRO Rajiv Shesh氏に聞く、企業価値創造の課題に応える「X-D-Oフレームワーク」

-

-

-

「プラグアンドゲイン・アプローチ」がプロセス変革のゲームチェンジャー。業務プロセスの持続的な改善を後押しする「SAP Signavio」

-

BPMとプロセスマイニングで継続的なプロセス改善を行う仕組みを構築、NTTデータ イントラマートがすすめる変革のアプローチ

-