NTTと東京大学は2023年1月10日、深層ニューラルネットワーク(NN)の計算過程に物理系を用いる「物理NN」に適した学習アルゴリズムを考案し、有効性を確認したと発表した。光を用いた物理NNに同アルゴリズムを適用し、学習過程を含めて物理NN上で効率的に計算可能であることを実証した。AI処理の電力消費や演算時間の低減につながるとしている。

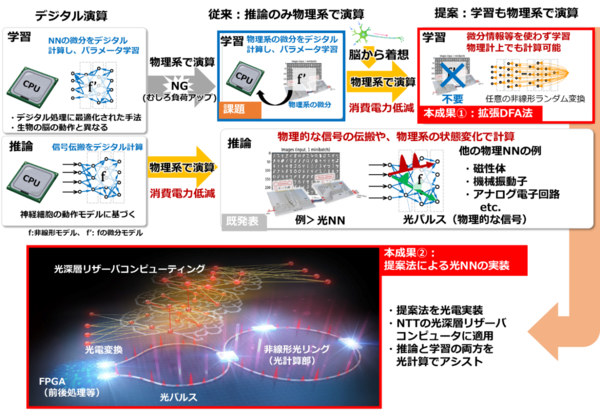

NTTと東京大学は、深層ニューラルネットワーク(NN)の計算過程に物理系を用いる「物理NN」に適した学習アルゴリズムを考案し、有効性を確認した。光を用いた物理NNに適用し、学習過程を含めて物理NN上で効率的に計算可能であることを実証した。AI処理の電力消費や演算時間の低減につながるとしている(図1)。

図1:深層ニューラルネットワークの計算過程に物理系を用いる「物理NN」に適した学習アルゴリズムを考案し、有効性を確認した(出典:NTT、東京大学)

図1:深層ニューラルネットワークの計算過程に物理系を用いる「物理NN」に適した学習アルゴリズムを考案し、有効性を確認した(出典:NTT、東京大学)拡大画像表示

NTTと東大は研究の背景を次のように説明している。「深層NNを高速に計算するための計算媒体として、コンピュータのデジタル演算ではなく、光各種の物理系の状態変化を計算過程として利用する物理NNに注目が集まっている。しかし現状では、深層NNの学習を物理系上で実現することは困難であり、学習計算の大部分をデジタル演算に依存している」。

両者によると、深層NNの学習は一般的に誤差逆伝搬法(BP法)と呼ぶアルゴリズムを用いるが、BP法は、学習パラメータや微分値といった深層NNの情報の正確な把握が前提である。「このため、物理NNにBP法を適用するには、高い精度での物理系の状態計測や、物理シミュレーションによる微分応答の近似などが必要になり、学習計算が複雑になっていた」という。

今回、NTTと東大は、物理NNに適した「拡張DFA法」と呼ぶアルゴリズムを開発した。脳の情報処理から着想を得て開発したDFA法と呼ぶ手法に着目し、これを物理NNでの実装に適する形に拡張した(図2)。特徴として、物理系の情報を正確に把握する必要がない点を挙げる。学習過程の簡略化により、物理NNで事実上実現できていなかった学習が可能になった。

図2:物理NNに適した「拡張DFA法」の概要。物理系の情報を正確に把握する必要がないことから、物理NNで事実上実現できていなかった学習が可能になった(出典:NTT、東京大学)

図2:物理NNに適した「拡張DFA法」の概要。物理系の情報を正確に把握する必要がないことから、物理NNで事実上実現できていなかった学習が可能になった(出典:NTT、東京大学)拡大画像表示

「従来のDFA法は、BP法と比べれば物理NNへの適用性が高いものの、依然として非線形変換やその導関数の計算が必要だった。今回の手法は、この部分を任意の非線形関数に置換できるようにDFA法を拡張した」(両者)。これにより、BP法で必要となっていた物理系の状態計測や、微分応答の物理シミュレーションによる近似、これに基づく逐次的な逆伝搬計算が不要になった。

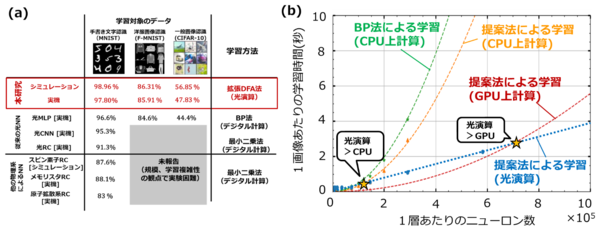

物理NNへの適用性を、実機での実験で検証した。深層リザーバコンピュータと呼ぶ深層NNモデルを光NN上に実装し、原理検証実験を行った。図3は、画像処理のベンチマークタスクの性能を比較した結果である。GPUとの比較では、モデルの大規模化に伴う光NNの学習加速効果を確認した。

今後は、今回開発したアルゴリズムを用いた、具体的な問題への適用性を検討する。さらに、光ハードウェアの大規模小型集積化を進める。

図3:物理NNに拡張DFA法を適用した場合のベンチマーク結果(出典:NTT、東京大学)

図3:物理NNに拡張DFA法を適用した場合のベンチマーク結果(出典:NTT、東京大学)拡大画像表示

- 業務システム 2027年4月強制適用へ待ったなし、施行迫る「新リース会計基準」対応の勘所【IT Leaders特別編集版】

- 生成AI/AIエージェント 成否のカギは「データ基盤」に─生成AI時代のデータマネジメント【IT Leaders特別編集号】

- フィジカルAI AI/ロボット─Society 5.0に向けた社会実装が広がる【DIGITAL X/IT Leaders特別編集号】

- メールセキュリティ 導入のみならず運用時の“ポリシー上げ”が肝心[DMARC導入&運用の極意]【IT Leaders特別編集号】

- ゼロトラスト戦略 ランサムウェア、AI詐欺…最新脅威に抗するデジタル免疫力を![前提のゼロトラスト、不断のサイバーハイジーン]【IT Leaders特別編集号】

-

-

-

-

-

-

-

-

-

-

-

-

-

AIの真価は「今この瞬間」の感知にある。「Data Streaming Platform」で実現する「AI Ready Data」を解説

-

-

-

-

VDIの導入コストを抑制! コストコンシャスなエンタープライズクラスの仮想デスクトップ「Parallels RAS」とは

-

AI時代の“基幹インフラ”へ──NEC・NOT A HOTEL・DeNAが語るZoomを核にしたコミュニケーション変革とAI活用法

-

加速するZoomの進化、エージェント型AIでコミュニケーションの全領域を変革─「Zoom主催リアルイベント Zoomtopia On the Road Japan」レポート

-

14年ぶりに到来したチャンスをどう活かす?企業価値向上とセキュリティ強化・運用効率化をもたらす自社だけの“ドメイン”とは

-

-

-

-

生成AIからAgentic AIへ―HCLSoftware CRO Rajiv Shesh氏に聞く、企業価値創造の課題に応える「X-D-Oフレームワーク」

-

-

-

「プラグアンドゲイン・アプローチ」がプロセス変革のゲームチェンジャー。業務プロセスの持続的な改善を後押しする「SAP Signavio」

-

BPMとプロセスマイニングで継続的なプロセス改善を行う仕組みを構築、NTTデータ イントラマートがすすめる変革のアプローチ

-