[新製品・サービス]

TED、大規模言語モデルの学習環境「AI Model Studioサービス」を提供

2023年8月24日(木)日川 佳三、河原 潤(IT Leaders編集部)

東京エレクトロン デバイス(TED)は2023年8月23日、大規模言語モデル学習プラットフォーム「AI Model Studioサービス」を提供開始した。大規模言語モデルの学習用計算資源をクラウドサービスとして提供する。GPUクラウドサービス事業者のハイレゾとの協業で提供する。計算資源として、米Cerebras Systemsのディープラーニング専用ネットワーク接続アクセラレータおよびAI学習用コンピュータ「CS-2」を利用する。

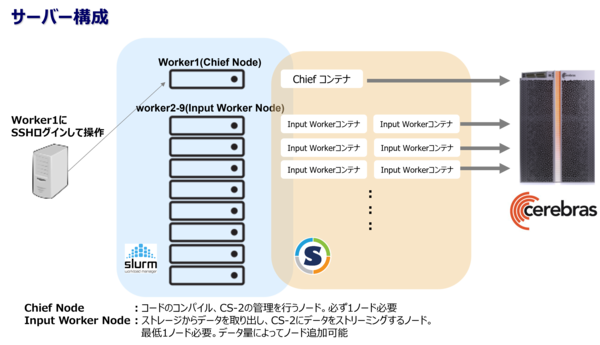

東京エレクトロン デバイス(TED)の「AI Model Studioサービス」は、大規模言語モデル(LLM)の学習環境をクラウドで提供するサービスである。計算資源として、米Cerebras Systems(セレブラスシステムズ)のディープラーニング専用ネットワーク接続アクセラレータおよびAI学習用コンピュータ「CS-2」を利用する(図1)。

図1:Cerebras Systems(セレブラスシステムズ)のディープラーニング専用ネットワーク接続アクセラレータを用いた計算資源環境(出典:米Cerebras Systems、東京エレクトロン デバイス)

図1:Cerebras Systems(セレブラスシステムズ)のディープラーニング専用ネットワーク接続アクセラレータを用いた計算資源環境(出典:米Cerebras Systems、東京エレクトロン デバイス)拡大画像表示

最小13億~最大1750億パラメータのモデルを選択して利用する(表1)。ユーザーが一般的なパブリッククラウドやハードウェアで同等の環境を用意する場合と比べて利用コストを約半額に抑えるという。また、AWSの最大GPUインスタンス構成と比べて8倍の性能で、数分の1の価格でLLMの学習が可能だとしている。

学習用のデータセットを用意して数行のコマンドを投じると、LLMを学習させられる。ゼロからモデルを学習させることも、オープンソースのモデルをベースに最小限のデータセットを用意してファインチューニングさせることも可能である。CS-2の利用方法については、TEDのエンジニアが技術サポートを提供する。

「ビジネスで利用可能な生成AIを独自に開発するためには、占有環境で大規模言語モデルをファインチューニングし、自社データを用いて学習させる必要がある。しかし、大規模言語モデルの学習にはGPUなど高速な計算処理能力を持つハードウェアリソースを多数用意しなければならず、インフラ資源の確保が課題となっている」(同社)

| モデル | パラメータ数 | Chinchillaモデル同等まで学習するのに必要なトークン数 | Cerebras AI Model Studioでの学習日数 | Cerebras AI Model Studioでの学習価格(米国) |

|---|---|---|---|---|

| GPT3-XL | 13億 | 260億 | 0.4 | 2500ドル |

| GPT-J | 60億 | 1200億 | 8 | 4万5000ドル |

| GPT-3 6.7B | 67億 | 1340億 | 11 | 4万ドル |

| T-5 11B | 110億 | 340億 | 9 | 6万ドル |

| GPT-3 13B | 130億 | 2600億 | 39 | 15万ドル |

| GPT NeoX | 200億 | 4000億 | 47 | 52万5000ドル |

| GPT 70B | 700億 | 1兆4000億 | 個別見積もり | 個別見積もり |

| GPT 175B | 1750億 | 3兆5000億 | 個別見積もり | 個別見積もり |

東京エレクトロン デバイス / 大規模言語モデル / 生成AI / ハイレゾ / ディープラーニング

- 業務システム 2027年4月強制適用へ待ったなし、施行迫る「新リース会計基準」対応の勘所【IT Leaders特別編集版】

- 生成AI/AIエージェント 成否のカギは「データ基盤」に─生成AI時代のデータマネジメント【IT Leaders特別編集号】

- フィジカルAI AI/ロボット─Society 5.0に向けた社会実装が広がる【DIGITAL X/IT Leaders特別編集号】

- メールセキュリティ 導入のみならず運用時の“ポリシー上げ”が肝心[DMARC導入&運用の極意]【IT Leaders特別編集号】

- ゼロトラスト戦略 ランサムウェア、AI詐欺…最新脅威に抗するデジタル免疫力を![前提のゼロトラスト、不断のサイバーハイジーン]【IT Leaders特別編集号】

-

-

-

-

-

-

-

-

-

AIの真価は「今この瞬間」の感知にある。「Data Streaming Platform」で実現する「AI Ready Data」を解説

-

-

-

-

VDIの導入コストを抑制! コストコンシャスなエンタープライズクラスの仮想デスクトップ「Parallels RAS」とは

-

AI時代の“基幹インフラ”へ──NEC・NOT A HOTEL・DeNAが語るZoomを核にしたコミュニケーション変革とAI活用法

-

加速するZoomの進化、エージェント型AIでコミュニケーションの全領域を変革─「Zoom主催リアルイベント Zoomtopia On the Road Japan」レポート

-

14年ぶりに到来したチャンスをどう活かす?企業価値向上とセキュリティ強化・運用効率化をもたらす自社だけの“ドメイン”とは

-

-

-

-

生成AIからAgentic AIへ―HCLSoftware CRO Rajiv Shesh氏に聞く、企業価値創造の課題に応える「X-D-Oフレームワーク」

-

-

-

「プラグアンドゲイン・アプローチ」がプロセス変革のゲームチェンジャー。業務プロセスの持続的な改善を後押しする「SAP Signavio」

-

BPMとプロセスマイニングで継続的なプロセス改善を行う仕組みを構築、NTTデータ イントラマートがすすめる変革のアプローチ

-