[技術解説]

マーケターや営業担当者にこそ“AIの力”を─Adobe Experience Cloudに備わるビジネス特化の生成AI機能

2024年6月4日(火)冨永 裕子(ITアナリスト/コンサルタント)

生成AIの自社製品への適用を進めるベンダーが数多ある中、米アドビ(Adobe)は、ユーザー/カスタマーエクスペリエンスの向上にこの技術を積極的に適用している。「Adobe Experience Cloud」における生成AIを活用した新アプリケーション「Adobe Experience Platform AI Assistant」および「Adobe GenStudio」がそれだ。生成AIがどのようなエクスペリエンスをもたらすのか、年次イベントのAdobe Summit 2024(2024年3月・米ラスベガス開催)のセッションで紹介された内容からポイントをピックアップして解説する。

CXアプリケーションに組み込む生成AIアシスタント

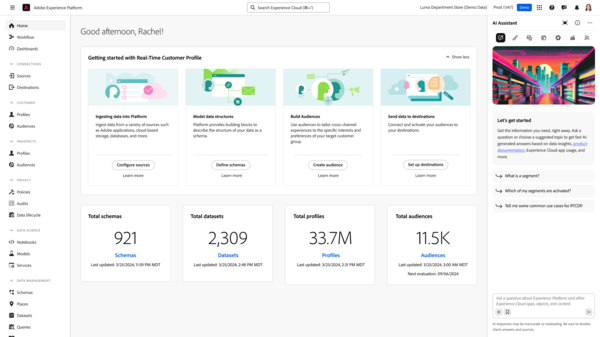

米アドビ(Adobe)は、Adobe Summit 2024初日の基調講演で、「Adobe Experience Platform AI Assistant(以降、AI Assistant)」を披露した(図1)。AI Assistantは、カスタマーエクスペリエンス(CX:顧客体験)の提供に関わる担当者が、自然言語による対話型インタフェースから生成AIの仕組みを駆使して自社のデータとコンテンツ資産にアクセスし、創造性を発揮しながら業務を遂行できることを目指した製品である。

図1:Adobe Experience Platform AI Assistantの使用イメージ(出典:アドビ)

図1:Adobe Experience Platform AI Assistantの使用イメージ(出典:アドビ)拡大画像表示

生成AIは、フロントのアプリケーション、基盤モデル/大規模言語モデル(LLM)、データといったレイヤーで構成されている。AI Assistantは、米OpenAIの「ChatGPT」のようなアプリケーションとして提供される。

アドビは、企業のCX向上を支援すべく、世界1万1000社以上の広範な業界に「Adobe Experience Cloud」を提供している。AI Assistantは、統合顧客プロファイルを作成する「Adobe Real-Time CDP」、統合顧客プロファイルからマルチチャネルジャーニーを最適化する「Adobe Journey Optimizer」、複雑なマルチチャネルジャーニーの問題を特定して、顧客に購入を促すプラン作成のためのインサイトを得る「Adobe Customer Journey Analytics」といったAdobe Experience Cloudの主要サービスに組み込まれるという(図2)。

図2:Adobe Experience Cloudの製品体系(出典:アドビ)

図2:Adobe Experience Cloudの製品体系(出典:アドビ)拡大画像表示

アプリケーションの下の基盤モデルには、独自開発の画像生成AIモデル「Adobe Firefly」が位置する(関連記事:「AIはクリエーターを補佐する副操縦士」─画像生成AIにAdobeならでのアプローチ)。発表から1年が経過したFireflyは、OpenAIのGPT-4のようなText-to-Textのモデルではなく、テキストから画像を生成する「Firefly Image 2 Model」を中核とし、ベクター生成の「Firefly Vector Model」、デザイン生成の「Firefly Design Model」も利用できる。2024年後半には、音声、動画、3Dモデルを生成できる基盤モデルを市場に投入する計画だ。

コンテンツのビジネス利用を可能にする3つのポイント

Fireflyのリリースは市場に大きな話題を呼んだ。特徴の1つは、プロンプトに入力したテキストから高品質のコンテンツを生成するだけでなく、ビジネスで安全に使えるように設計されていること。AIが作成した画像をそのままビジネスで使えるかは、顧客体験の最前線にいるマーケティング部門にとってきわめて重要だ。

現行のChatGPTでは、文章だけでなく、「DALL-E 3」にAPI接続することで画像生成も可能だ。しかし、その画像は自社が運営するWebサイトやモバイルアプリで使いたいと思えるようなものになっているかどうか。文章生成でも個人利用とビジネス利用とでは要件は異なってくる。企業がブランドらしさを表現したコンテンツを作成し、それを公開するとなれば、より厳しい要件をクリアすることが求められる。

米アドビ デジタルメディア事業部門担当 シニアバイスプレジデント(SVP)兼 最高技術責任者(CTO)のイーリー・グリーンフィールド(Ely Greenfield)氏は、企業が安心して生成AIによる画像を利用するにあたって必要なことを次のように述べている。

第1にトレーニングである。AIにゴミを与えても、出てくるのはゴミでしかない。出所の確かなデータを使い、モデルのチューニングを行うことは、出力結果がテキストでも画像でも同じだ。

第2にハルシネーション防止がある。偶然にでもだれかを傷つけるようなもの、偏見を助長するようなものをAIに作らせないよう、ガードレールを設置しなくてはならない。

最後に最も大事なのが信頼性を担保するためのコントロールである。アドビでは、顧客が自社のデータ資産を、外部の一般的なものから分離し、安全な保護を維持する仕組みが必要になると考えたという。

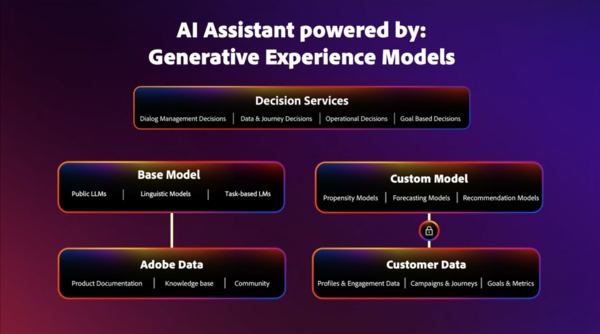

AI Assistantの裏側ではこの3つの条件を満たした仕組みが整備されている。そのエンジンになるのが「Generative Experience Models」である。これはモデルのコレクションで、すべてのモデルが一体となってAI Assistantを動かしている。図3のとおり、モデルには大きくベースモデルとカスタムモデルの2つがある。一番上に位置する「意思決定サービス」のレイヤーは、基盤モデルの出力結果を最終的に調整し、AI Assistantを使うユーザーの意思決定を支援する役割を持つ。

図3:AI Assistantを支えるGenerative Experience Modelsの仕組み(出典:アドビ)

図3:AI Assistantを支えるGenerative Experience Modelsの仕組み(出典:アドビ)拡大画像表示

●Next:クリエーターだけでなく、ビジネスパーソンにこそ生成AIの価値を届けたい

会員登録(無料)が必要です

- 1

- 2

- 次へ >

- 業務システム 2027年4月強制適用へ待ったなし、施行迫る「新リース会計基準」対応の勘所【IT Leaders特別編集版】

- 生成AI/AIエージェント 成否のカギは「データ基盤」に─生成AI時代のデータマネジメント【IT Leaders特別編集号】

- フィジカルAI AI/ロボット─Society 5.0に向けた社会実装が広がる【DIGITAL X/IT Leaders特別編集号】

- メールセキュリティ 導入のみならず運用時の“ポリシー上げ”が肝心[DMARC導入&運用の極意]【IT Leaders特別編集号】

- ゼロトラスト戦略 ランサムウェア、AI詐欺…最新脅威に抗するデジタル免疫力を![前提のゼロトラスト、不断のサイバーハイジーン]【IT Leaders特別編集号】

-

-

-

-

-

-

-

-

-

-

AIの真価は「今この瞬間」の感知にある。「Data Streaming Platform」で実現する「AI Ready Data」を解説

-

-

-

-

VDIの導入コストを抑制! コストコンシャスなエンタープライズクラスの仮想デスクトップ「Parallels RAS」とは

-

AI時代の“基幹インフラ”へ──NEC・NOT A HOTEL・DeNAが語るZoomを核にしたコミュニケーション変革とAI活用法

-

加速するZoomの進化、エージェント型AIでコミュニケーションの全領域を変革─「Zoom主催リアルイベント Zoomtopia On the Road Japan」レポート

-

14年ぶりに到来したチャンスをどう活かす?企業価値向上とセキュリティ強化・運用効率化をもたらす自社だけの“ドメイン”とは

-

-

-

-

生成AIからAgentic AIへ―HCLSoftware CRO Rajiv Shesh氏に聞く、企業価値創造の課題に応える「X-D-Oフレームワーク」

-

-

-

「プラグアンドゲイン・アプローチ」がプロセス変革のゲームチェンジャー。業務プロセスの持続的な改善を後押しする「SAP Signavio」

-

BPMとプロセスマイニングで継続的なプロセス改善を行う仕組みを構築、NTTデータ イントラマートがすすめる変革のアプローチ

-