[新製品・サービス]

ピクセルカンパニーズ、生成AI向けコンテナ型データセンターを販売、コンテナ5台/GPU512基で構成

2024年8月22日(木)日川 佳三、河原 潤(IT Leaders編集部)

ピクセルカンパニーズは2024年8月22日、生成AIシステムの稼働基盤に向くコンテナ型データセンターを販売開始した。生成AIの需要を受け、企業や大学・研究機関などに提供する。コンテナ5台/GPU最大512基構成で、販売時の仕様としてGPUに「NVIDIA H100」を搭載する計画である。

SI/データセンター事業者のピクセルカンパニーズは、生成AIシステムの稼働基盤に向く、GPUに特化したコンテナ型データセンターを販売開始した。生成AIの需要を受け、企業や大学・研究機関などに向けて提供する。

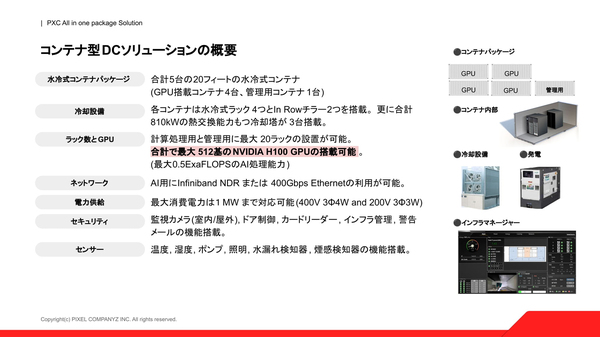

ファシリティとして、20フィート(約6m)の水冷式コンテナ5台(GPU搭載コンテナ4台、管理用コンテナ1台)、コンテナあたり4ラック構成で、GPUサーバー最大16台(GPU最大512基)を搭載することができる。販売当初の仕様ではGPUに「NVIDIA H100」を搭載する計画である(図1)。

図1:GPUに特化したコンテナ型データセンターの概要(出典:ピクセルカンパニーズ)

図1:GPUに特化したコンテナ型データセンターの概要(出典:ピクセルカンパニーズ)拡大画像表示

コンテナ型データセンターの設計にあたっては、スーパーマイクロ(Supermicro)から技術提供を受けて、GPUサーバーラック、冷却装置、発電装置をコンテナの規格に合わせて個別に製作、現地で組み上げる工法を採用している。設備の更新が容易で、GPUの開発サイクルが加速度的に進む中でも常に新しい製品を導入しやすいという。

「一般的な建物型データセンターを建設する場合、通常4~5年の工期を要する。対してコンテナ型では全体工期を半年程度に短縮できる。最小構成として、コンテナ5台と冷却塔など必要設備を置ける広さがあれば設置可能で、用地の確保も容易である」(ピクセルカンパニーズ)

サーバー冷却装置は水冷式。GPUはCPUと比較して発熱量が大きく、一般的な空冷式では冷却効率および消費電力に課題があることから採用した。冷却水を循環利用することで、空冷式と比べて使用電力を15~20%削減し、計算リソースに使用できる電力が38%増加するという。

現在、ピクセルカンパニーズは、経済産業省の補助金を受けて福島県双葉郡大熊町にコンテナ型データセンターの建設を進めており、2024年中の稼働開始を予定している。今回、販売開始したのは、同データセンターの建設を通じて培ったノウハウをパッケージにしたものである。

ピクセルカンパニーズ / コンテナ型データセンター / GPU / NVIDIA / ITインフラ / Supermicro / 生成AI

- 業務システム 2027年4月強制適用へ待ったなし、施行迫る「新リース会計基準」対応の勘所【IT Leaders特別編集版】

- 生成AI/AIエージェント 成否のカギは「データ基盤」に─生成AI時代のデータマネジメント【IT Leaders特別編集号】

- フィジカルAI AI/ロボット─Society 5.0に向けた社会実装が広がる【DIGITAL X/IT Leaders特別編集号】

- メールセキュリティ 導入のみならず運用時の“ポリシー上げ”が肝心[DMARC導入&運用の極意]【IT Leaders特別編集号】

- ゼロトラスト戦略 ランサムウェア、AI詐欺…最新脅威に抗するデジタル免疫力を![前提のゼロトラスト、不断のサイバーハイジーン]【IT Leaders特別編集号】

-

-

-

-

-

-

-

-

-

-

-

-

AIの真価は「今この瞬間」の感知にある。「Data Streaming Platform」で実現する「AI Ready Data」を解説

-

-

-

-

VDIの導入コストを抑制! コストコンシャスなエンタープライズクラスの仮想デスクトップ「Parallels RAS」とは

-

AI時代の“基幹インフラ”へ──NEC・NOT A HOTEL・DeNAが語るZoomを核にしたコミュニケーション変革とAI活用法

-

加速するZoomの進化、エージェント型AIでコミュニケーションの全領域を変革─「Zoom主催リアルイベント Zoomtopia On the Road Japan」レポート

-

14年ぶりに到来したチャンスをどう活かす?企業価値向上とセキュリティ強化・運用効率化をもたらす自社だけの“ドメイン”とは

-

-

-

-

生成AIからAgentic AIへ―HCLSoftware CRO Rajiv Shesh氏に聞く、企業価値創造の課題に応える「X-D-Oフレームワーク」

-

-

-

「プラグアンドゲイン・アプローチ」がプロセス変革のゲームチェンジャー。業務プロセスの持続的な改善を後押しする「SAP Signavio」

-

BPMとプロセスマイニングで継続的なプロセス改善を行う仕組みを構築、NTTデータ イントラマートがすすめる変革のアプローチ

-