PwCコンサルティングは2021年7月14日、AI活用のガバナンス体制を構築するサービス「Responsible AI導入サービス」を開始した。AIの開発と活用に取り組む企業を対象に、社会に対して倫理的で公平かつ安全な責任あるAIシステムを活用できるように支援する。

PwCコンサルティングの「Responsible AI導入サービス」は、AIを開発・活用する企業を対象に、AI活用のガバナンス体制を構築するサービスである。AIを開発・活用する上での各種のリスクを考慮したガバナンスの整備を包括的に支援する。

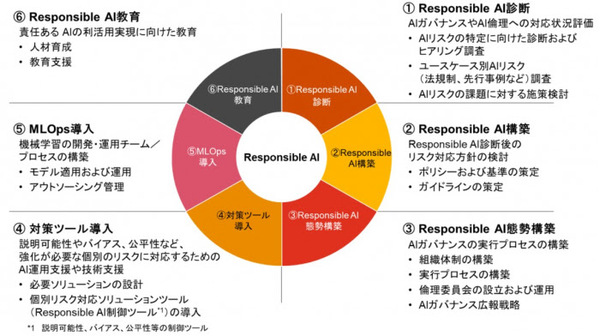

日本を含む世界各国のPwCグローバルネットワークにおいて、PwCのクライアントが抱えるAIリスクへの対応を支援した実績をベースに開発した。以下の6つのサービス領域で構成する(図1)。

図1:6つのサービス領域(出典:PwCコンサルティング)

図1:6つのサービス領域(出典:PwCコンサルティング)拡大画像表示

- Responsible AI診断:AIガバナンスやAI倫理への対応状況を評価

- Responsible AI構築:Responsible AI診断後のリスク対応方針を検討

- Responsible AI態勢構築:AIガバナンスの実行プロセスを構築

- 対策ツール導入:説明可能性やバイアス、公平性など、強化が必要な個別のリスクに対応するためのAI運用支援や技術支援

- MLOps導入:機械学習の開発・運用チーム/プロセスを構築

- Responsible AI教育:責任あるAIの活用実現に向けた教育

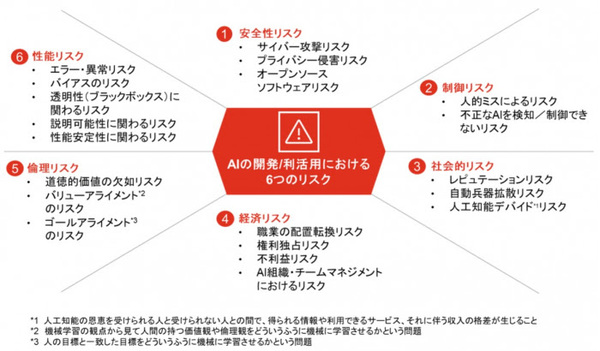

Responsible AI診断では、AIの開発と活用に関わる6つのリスクを軸に、クライアント企業の組織上の課題から、個別のユースケースの課題まで、幅広くAIリスクを特定する(図2)。この上で、企業のAI活用やガバナンスへの取り組み状況に応じた施策を検討する。また、AIの開発や活用のライフサイクルに応じて、技術的側面や法規制の動向、ガバナンスの先行事例を踏まえたサービスを提供する。

図2:AIの開発および活用に関わる6つのリスク(出典:PwCコンサルティング)

図2:AIの開発および活用に関わる6つのリスク(出典:PwCコンサルティング)拡大画像表示

サービス提供の背景として同社は、AI活用のリスクを適切に制御したうえでAI活用による効果を最大化するAIガバナンスの整備がユーザーにとっての喫緊の課題になっている状況を挙げる。「AIの開発や活用にはリスクがあることを十分に理解し、AIの信頼性と説明可能性を担保することが求められている」(同社)

「迅速かつ適切な意思決定のためにAIやデータを活用するAI経営が求められる一方で、AIの意思決定によるインシデントや倫理違反、人種や性別などによる差別的バイアス、プライバシーの侵害といったリスクを回避するための取り組みが不可欠となっている」(同社)

同社によると、これまでにも、OECDやG20がAIの原則を取りまとめてきたが、2021年に入ってEUがリスクベースのAI規制枠組案を提示し、米国の連邦取引委員会(FTC)がAI規制による摘発を開始するなど、欧米では法規制の強化が活発化しているという。「各国政府もAIリスクを制御し、AIアルゴリズムに説明責任を負わせるための法的枠組みの構築に着手している。日本においても、政府による議論が進んでいる」(同社)

- 業務システム 2027年4月強制適用へ待ったなし、施行迫る「新リース会計基準」対応の勘所【IT Leaders特別編集版】

- 生成AI/AIエージェント 成否のカギは「データ基盤」に─生成AI時代のデータマネジメント【IT Leaders特別編集号】

- フィジカルAI AI/ロボット─Society 5.0に向けた社会実装が広がる【DIGITAL X/IT Leaders特別編集号】

- メールセキュリティ 導入のみならず運用時の“ポリシー上げ”が肝心[DMARC導入&運用の極意]【IT Leaders特別編集号】

- ゼロトラスト戦略 ランサムウェア、AI詐欺…最新脅威に抗するデジタル免疫力を![前提のゼロトラスト、不断のサイバーハイジーン]【IT Leaders特別編集号】

-

-

-

-

-

-

-

-

-

-

-

-

AIの真価は「今この瞬間」の感知にある。「Data Streaming Platform」で実現する「AI Ready Data」を解説

-

-

-

-

VDIの導入コストを抑制! コストコンシャスなエンタープライズクラスの仮想デスクトップ「Parallels RAS」とは

-

AI時代の“基幹インフラ”へ──NEC・NOT A HOTEL・DeNAが語るZoomを核にしたコミュニケーション変革とAI活用法

-

加速するZoomの進化、エージェント型AIでコミュニケーションの全領域を変革─「Zoom主催リアルイベント Zoomtopia On the Road Japan」レポート

-

14年ぶりに到来したチャンスをどう活かす?企業価値向上とセキュリティ強化・運用効率化をもたらす自社だけの“ドメイン”とは

-

-

-

-

生成AIからAgentic AIへ―HCLSoftware CRO Rajiv Shesh氏に聞く、企業価値創造の課題に応える「X-D-Oフレームワーク」

-

-

-

「プラグアンドゲイン・アプローチ」がプロセス変革のゲームチェンジャー。業務プロセスの持続的な改善を後押しする「SAP Signavio」

-

BPMとプロセスマイニングで継続的なプロセス改善を行う仕組みを構築、NTTデータ イントラマートがすすめる変革のアプローチ

-