ソフトバンク(本社:東京都港区)は、コールセンターの通話内容を要約する用途で、大規模言語モデル(LLM)をコールセンター向けにファインチューニングを行い、2024年10月から業務に適用している。アドバンスト・メディアのファインチューニング作業による業務に最適化したLLMを整備し、業務経験が浅い新人オペレーターによる要約時間を約30%削減できる見込みという。アドバンスト・メディアが同年12月17日に発表した。

ソフトバンクは、コールセンターの通話内容を要約する用途で、大規模言語モデル(LLM)をコールセンター向けにファインチューニングを行い、2024年10月から業務に適用している。アドバンスト・メディアのファインチューニング作業による業務に最適化したLLMを整備し、業務経験が浅い新人オペレーターによる要約時間を約30%削減できる見込みという。

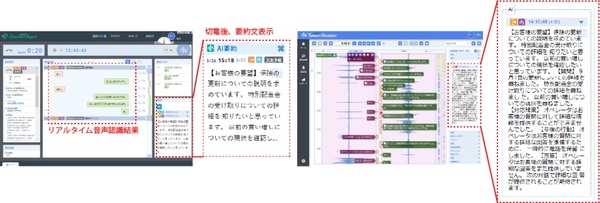

画面1:「AOI LLM for AmiVoice Communication Suite」の利用画面例(出典:アドバンスト・メディア)

画面1:「AOI LLM for AmiVoice Communication Suite」の利用画面例(出典:アドバンスト・メディア)拡大画像表示

LLMには、アドバンスト・メディアのコンタクトセンター向け生成AIソフトウェア「AOI LLM for AmiVoice Communication Suite」を利用している(図1、関連記事:アドバンスト・メディア、コンタクトセンター業務に特化した生成AIソフトウェア「AOI LLM」を発表)。

AOI LLMは、コンタクトセンター向け音声認識ソフトウェア「AmiVoice Communication Suite」のオプション製品である。LLMを用いて通話内容の要約やQ&Aの抜粋、VoC(顧客の声)の抽出などが可能。RAG(検索拡張生成)構成に対応するほか、目的に合わせて、LLMにファインチューニングを施してユーザーの業務に最適化したLLMを構築できる。

ソフトバンクのコールセンター環境では、米MetaのLlamaをベースに東京科学大学(2024年10月に東京工業大学と東京医科歯科大学が統合して名称変更)が日本語能力を強化したLLM「Swallow-70b」に対し、アドバンスト・メディアがソフトバンクの学習データを利用してファインチューニングを施している。

ソフトバンク / コールセンター / Llama / 大規模言語モデル / アドバンスト・メディア / 音声認識 / 通信事業者 / コンタクトセンター / ファインチューニング / 東京科学大学

- 業務システム 2027年4月強制適用へ待ったなし、施行迫る「新リース会計基準」対応の勘所【IT Leaders特別編集版】

- 生成AI/AIエージェント 成否のカギは「データ基盤」に─生成AI時代のデータマネジメント【IT Leaders特別編集号】

- フィジカルAI AI/ロボット─Society 5.0に向けた社会実装が広がる【DIGITAL X/IT Leaders特別編集号】

- メールセキュリティ 導入のみならず運用時の“ポリシー上げ”が肝心[DMARC導入&運用の極意]【IT Leaders特別編集号】

- ゼロトラスト戦略 ランサムウェア、AI詐欺…最新脅威に抗するデジタル免疫力を![前提のゼロトラスト、不断のサイバーハイジーン]【IT Leaders特別編集号】

-

-

-

-

-

-

-

-

-

-

-

AIの真価は「今この瞬間」の感知にある。「Data Streaming Platform」で実現する「AI Ready Data」を解説

-

-

-

-

VDIの導入コストを抑制! コストコンシャスなエンタープライズクラスの仮想デスクトップ「Parallels RAS」とは

-

AI時代の“基幹インフラ”へ──NEC・NOT A HOTEL・DeNAが語るZoomを核にしたコミュニケーション変革とAI活用法

-

加速するZoomの進化、エージェント型AIでコミュニケーションの全領域を変革─「Zoom主催リアルイベント Zoomtopia On the Road Japan」レポート

-

14年ぶりに到来したチャンスをどう活かす?企業価値向上とセキュリティ強化・運用効率化をもたらす自社だけの“ドメイン”とは

-

-

-

-

生成AIからAgentic AIへ―HCLSoftware CRO Rajiv Shesh氏に聞く、企業価値創造の課題に応える「X-D-Oフレームワーク」

-

-

-

「プラグアンドゲイン・アプローチ」がプロセス変革のゲームチェンジャー。業務プロセスの持続的な改善を後押しする「SAP Signavio」

-

BPMとプロセスマイニングで継続的なプロセス改善を行う仕組みを構築、NTTデータ イントラマートがすすめる変革のアプローチ

-