[「人間中心のAI」で企業変革を加速する─生成AIの進化・活用のこれから]

信頼されるAIの実現へ─企業が取り組むべきAIガバナンスの4層アプローチと「人間中心」の視点:第5回

2025年7月4日(金)森 正弥(博報堂DYホールディングス 執行役員/CAIO, Human-Centered AI Institute 代表)

AI技術は日々進化を遂げ、社会実装が現実の段階に入っているが、多くの企業ではまだ部分的な活用にとどまり、AIに対する脅威や不安のマインドが依然として存在する。あるべき姿は「人間中心のAI活用」であり、その推進にあたって何をなすべきか。本連載では、具体的なアプローチを交えながら、企業がAIをどのように向き合い、活用し、未来の成長に役立てていくかを考察していく。第5回では、AIガバナンスのあり方と、「人間中心のAI」視点によるアップデートの可能性について解説する。

今求められるAIガバナンス─4つの階層で構築する信頼性

本連載ではこれまで、生成AIを企業・組織の業務においてどのように活用していくかについて述べてきた。今回は、AIを扱ううえで避けることのできない課題である「AIガバナンス」について、組織におけるあり方と、「人間中心のAI」の視座からのアップデートの可能性について論じてみたい。

とどまることのない、かつ急速なAIの進化。その一方で、企業や社会の中での活用においては課題、懸念が多々存在する。処理過程のブラックボックス化の問題や、データバイアスに伴うAIの公平性を欠いた判断や出力、技術の特性上、偽情報をもっともらしく返してくるハルシネーションなどだ。

AIの利用にまつわるリスクは、単なる技術的な対策だけでは回避できなくなりつつある。そのため、信頼性を確立するAIガバナンスには、多層的なアプローチが必要となる。

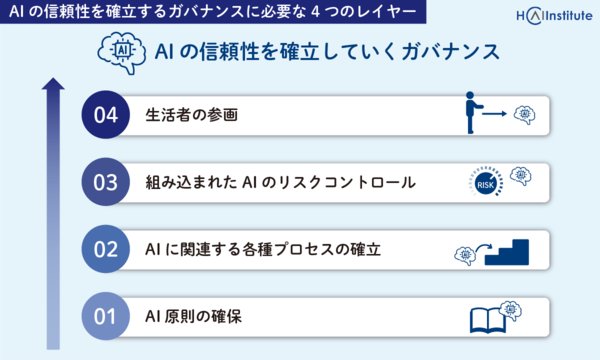

図1は、企業が取り組むべきアプローチを、「AI原則の確保」「AIに関連する各種プロセスの確立」「組み込まれたAIのリスクコントロール」「生活者の参画」という4つのレイヤーで下から順に示したものだ。以下でそれぞれを説明しよう。

図1:AIの信頼性を確立していくガバナンス(出典:Human-Centered AI Institute)

図1:AIの信頼性を確立していくガバナンス(出典:Human-Centered AI Institute)拡大画像表示

レイヤー1:AI原則の確保

倫理的基盤と価値観の統合

まず求められるのが、AI原則の確保だ。これは、AIが社会で実装されていくことを想定した際に、求められる設計思想や機能的要件を示すものである。

AIに関して以前より重要視されてきたのは、透明性や説明可能性を確保し、公正性や公平性を欠いた活用を防止すること。こうした観点は、倫理的、法的、社会的課題(Ethical, Legal and Social Issues)への配慮として、多くの組織・団体によって、開発指針や原則として整理の試みがなされてきた。

代表的な例としては、AIの安全性と人類への影響を研究する非営利団体のFuture of Life Instituteによる「アシロマAI原則」(注1)、マイクロソフト、IBM、グーグルといった主要なテクノロジー企業やUNESCO(国際連合教育科学文化機関)などの公的機関がそれぞれ定めているAI原則あたりが広く知られている。

そして、近年の生成AIの急速な発展がこの領域の議論に大きな影響を及ぼしている。公平性・透明性・説明可能性、頑健性、セキュリティ、プライバシー保護といった、これまで重視されてきた観点に加え、生成される情報の信憑性や、人間の価値観との整合性などが重要なポイントとして浮上してきている。

注1:アシロマAI原則(Asilomar AI Principles)は、AI の研究、倫理・価値観、将来的な問題の3分野に関する23の原則で構成。2017年1月に米カリフォルニア州アシロマで開催した「有益なAIに関するアシロマ会議(Asilomar Conference on Beneficial AI)」で策定された。

●Next:AIガバナンスがビジネス価値をもたらす

会員登録(無料)が必要です

- 1

- 2

- 次へ >

- AIがコードを書き、人間がプロジェクトを導く─AI駆動開発時代のエンジニア像:第10回(2026/04/03)

- AI活用の推進・調整役「CoE」をどう組織するか─全社にAIパワーを広げるための実践知:第9回(2026/02/18)

- 人間同士の絆を深めるAI─若手が経営層を導く「AIメンタリング」の成果:第8回(2026/02/04)

- 「責任あるAI活用」に不可欠なAIガバナンス、企業がなすべき取り組みは?:第7回(2025/10/01)

- 生成AIに信頼を寄せる若者たち─「AIネイティブ」が企業に突きつける課題:第6回(2025/09/08)

博報堂DYホールディングス / ITガバナンス / 生成AI / AI倫理

- 業務システム 2027年4月強制適用へ待ったなし、施行迫る「新リース会計基準」対応の勘所【IT Leaders特別編集版】

- 生成AI/AIエージェント 成否のカギは「データ基盤」に─生成AI時代のデータマネジメント【IT Leaders特別編集号】

- フィジカルAI AI/ロボット─Society 5.0に向けた社会実装が広がる【DIGITAL X/IT Leaders特別編集号】

- メールセキュリティ 導入のみならず運用時の“ポリシー上げ”が肝心[DMARC導入&運用の極意]【IT Leaders特別編集号】

- ゼロトラスト戦略 ランサムウェア、AI詐欺…最新脅威に抗するデジタル免疫力を![前提のゼロトラスト、不断のサイバーハイジーン]【IT Leaders特別編集号】

-

-

-

-

-

-

-

-

-

-

-

-

AIの真価は「今この瞬間」の感知にある。「Data Streaming Platform」で実現する「AI Ready Data」を解説

-

-

-

-

VDIの導入コストを抑制! コストコンシャスなエンタープライズクラスの仮想デスクトップ「Parallels RAS」とは

-

AI時代の“基幹インフラ”へ──NEC・NOT A HOTEL・DeNAが語るZoomを核にしたコミュニケーション変革とAI活用法

-

加速するZoomの進化、エージェント型AIでコミュニケーションの全領域を変革─「Zoom主催リアルイベント Zoomtopia On the Road Japan」レポート

-

14年ぶりに到来したチャンスをどう活かす?企業価値向上とセキュリティ強化・運用効率化をもたらす自社だけの“ドメイン”とは

-

-

-

-

生成AIからAgentic AIへ―HCLSoftware CRO Rajiv Shesh氏に聞く、企業価値創造の課題に応える「X-D-Oフレームワーク」

-

-

-

「プラグアンドゲイン・アプローチ」がプロセス変革のゲームチェンジャー。業務プロセスの持続的な改善を後押しする「SAP Signavio」

-

BPMとプロセスマイニングで継続的なプロセス改善を行う仕組みを構築、NTTデータ イントラマートがすすめる変革のアプローチ

-