NRIセキュアテクノロジーズ(NRIセキュア)は2025年7月30日、AI脅威分析サービス「AI Yellow Team」を提供開始した。AIエージェントを構築する企業向けに、システムの設計段階で潜在脅威を洗い出して対策案を提示する。料金は個別見積もり。

NRIセキュアテクノロジーズの「AI Yellow Team」は、AIエージェントシステムの設計段階で潜在脅威を洗い出して対策案を提示するサービスである。

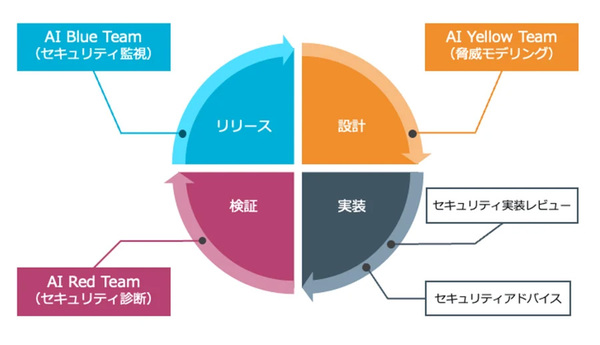

既存の「AI Red Team」(リリース前のセキュリティ診断)および「AI Blue Team」(リリース後のセキュリティ監視)と補完関係にある(図1、関連記事:NRIセキュア、生成AIシステムの脆弱性を疑似攻撃で診断する「AI Red Team」を提供)。

図1:AIを活用したシステムの設計からリリース段階における、NRIセキュアの提供サービス(出典:NRIセキュアテクノロジーズ)

図1:AIを活用したシステムの設計からリリース段階における、NRIセキュアの提供サービス(出典:NRIセキュアテクノロジーズ)拡大画像表示

近年、MCP(Model Context Protocol)でAIモデルを外部データソースやツールと連携させるケースや、複数のAIエージェントを協調させるケースが増えている。「一方で、AIエージェントの自律的な実行能力が悪用され、AIエージェントが果たすべき目的が段階的に書き換えられるなど、AIエージェント特有の脅威が顕在化している。問題が見つかって改修や再検証が必要となった場合、手戻りや追加コストは、従来システムを上回る可能性もある」(NRIセキュア)。

AI Yellow Teamは、以下の4つのステップに沿って提供する。

- ヒアリング:設計書を基にシステムアーキテクチャと仕様をヒアリングする

- 可視化:外部システムとの結合を含めた、各機能における脅威分析用のアーキテクチャとデータフロー図を作成する

- 脅威分析:作成したアーキテクチャとデータフロー図をもとに、システムに対する潜在的な脅威を洗い出す。脅威の埋め込みから発動までのシナリオを検討し、想定されるリスクを分析する

- セキュリティ対策の提示:洗い出した脅威に対する具体的な対策を「セキュリティ要件一覧」として提示する

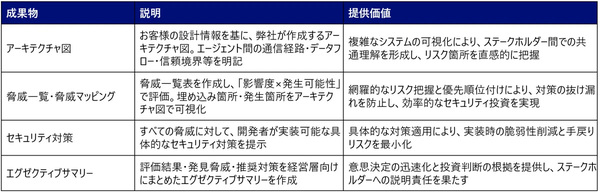

表1:「AI Yellow Team」の主な成果物(出典:NRIセキュアテクノロジーズ)

表1:「AI Yellow Team」の主な成果物(出典:NRIセキュアテクノロジーズ)拡大画像表示

分析後、潜在的な脅威を一覧化してユーザーに提示する(表1)。「OWASP Top 10 for LLM」や「OWASP Agentic AI Threats and Mitigations」など、国際的ガイドラインに準拠した脅威カタログを参照し、「経験や勘に頼らず、体系的・客観的にリスクを洗い出し、アーキテクチャ図にマッピングした視覚的な脅威マップとして提供する」(同社)としている。

脅威マップでは、各脅威を「影響度×発生可能性」で評価し、リスクマトリクスとして可視化する。ビジネス影響度の高い脅威から優先的に対策することで、限られた予算・工数を効果的に配分可能である。経営層への報告や投資判断に必要な定量的データを提供するとしている。

- 業務システム 2027年4月強制適用へ待ったなし、施行迫る「新リース会計基準」対応の勘所【IT Leaders特別編集版】

- 生成AI/AIエージェント 成否のカギは「データ基盤」に─生成AI時代のデータマネジメント【IT Leaders特別編集号】

- フィジカルAI AI/ロボット─Society 5.0に向けた社会実装が広がる【DIGITAL X/IT Leaders特別編集号】

- メールセキュリティ 導入のみならず運用時の“ポリシー上げ”が肝心[DMARC導入&運用の極意]【IT Leaders特別編集号】

- ゼロトラスト戦略 ランサムウェア、AI詐欺…最新脅威に抗するデジタル免疫力を![前提のゼロトラスト、不断のサイバーハイジーン]【IT Leaders特別編集号】

-

-

-

-

-

-

-

-

-

-

-

AIの真価は「今この瞬間」の感知にある。「Data Streaming Platform」で実現する「AI Ready Data」を解説

-

-

-

-

VDIの導入コストを抑制! コストコンシャスなエンタープライズクラスの仮想デスクトップ「Parallels RAS」とは

-

AI時代の“基幹インフラ”へ──NEC・NOT A HOTEL・DeNAが語るZoomを核にしたコミュニケーション変革とAI活用法

-

加速するZoomの進化、エージェント型AIでコミュニケーションの全領域を変革─「Zoom主催リアルイベント Zoomtopia On the Road Japan」レポート

-

14年ぶりに到来したチャンスをどう活かす?企業価値向上とセキュリティ強化・運用効率化をもたらす自社だけの“ドメイン”とは

-

-

-

-

生成AIからAgentic AIへ―HCLSoftware CRO Rajiv Shesh氏に聞く、企業価値創造の課題に応える「X-D-Oフレームワーク」

-

-

-

「プラグアンドゲイン・アプローチ」がプロセス変革のゲームチェンジャー。業務プロセスの持続的な改善を後押しする「SAP Signavio」

-

BPMとプロセスマイニングで継続的なプロセス改善を行う仕組みを構築、NTTデータ イントラマートがすすめる変革のアプローチ

-