マクニカは2024年6月17日、イスラエルDeepKeepのAIシステム向けセキュリティソフトウェア「DeepKeep」を販売すると発表した。AIモデルや学習データに含まれるリスクを洗い出し、優先度を付けて表示する。

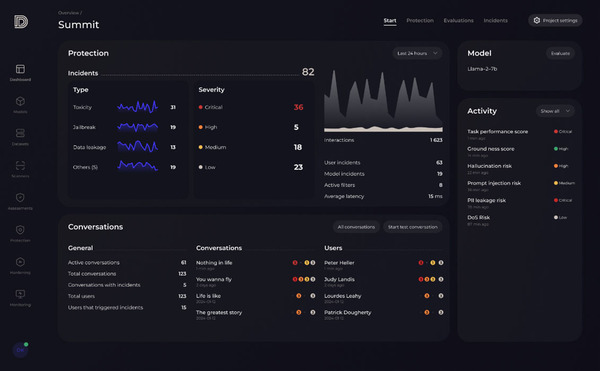

マクニカが販売する「DeepKeep」は、イスラエルのDeepKeepが開発した、AIシステム向けのセキュリティソフトウェアである。大規模言語モデル(LLM)やコンピュータビジョンモデルに含まれるリスクや学習データに含まれるリスクを洗い出し、優先度を付けて表示する(画面1)。

画面1:「DeepKeep」のダッシュボードサンプル(出典:マクニカ)

画面1:「DeepKeep」のダッシュボードサンプル(出典:マクニカ)拡大画像表示

「生成AIが普及する一方、AIモデルへの悪意のある攻撃や意図せぬ情報漏洩などのリスクが顕在化している。AIのセキュリティと信頼性をいかに確保するかが課題となっている」(マクニカ)ことから同製品を販売する。以下の4つの機能が備わっている。

(1)リスクアセスメント(ペネトレーションテストを自動実施)

- モデル/データをアップロードして検査項目を指定し、脆弱性を評価する

- ポイズニングとバックドアを検出する

- 発見した課題に対して優先順位を付けて推奨事項を提示する

(2)予防(課題に対するセキュリティ強化策の提示)

- 発見した課題に対処するための前処理・後処理を実行する

- AIモデルの修復案を提案する

(3)検知(モデルの性能を損なわずに検知)

- リアルタイム検知および事後検知を行う

- 異常値などを検出する

(4)緩和(AIファイアウォールによる緩和策の提供)

- 検知時にアクセスを制限する

- リアルタイムにアラートを発する

- SOC(セキュリティオペレーションセンター)と連携して被害の緩和を図る

マクニカは、AIシステムのセキュリティを確保する製品・サービスとして、匿名加工の「brighter AI」や個人情報匿名化の「Private AI」を提供している。子今回、DeepKeepの販売を加えることで、AIのリスクに対処する手段を提供する(関連記事:マクニカ、個人情報匿名化ソフト「Private AI」を販売、生成AIのプライバシー保護を支援)。

- 業務システム 2027年4月強制適用へ待ったなし、施行迫る「新リース会計基準」対応の勘所【IT Leaders特別編集版】

- 生成AI/AIエージェント 成否のカギは「データ基盤」に─生成AI時代のデータマネジメント【IT Leaders特別編集号】

- フィジカルAI AI/ロボット─Society 5.0に向けた社会実装が広がる【DIGITAL X/IT Leaders特別編集号】

- メールセキュリティ 導入のみならず運用時の“ポリシー上げ”が肝心[DMARC導入&運用の極意]【IT Leaders特別編集号】

- ゼロトラスト戦略 ランサムウェア、AI詐欺…最新脅威に抗するデジタル免疫力を![前提のゼロトラスト、不断のサイバーハイジーン]【IT Leaders特別編集号】

-

-

-

-

-

-

-

-

-

-

AIの真価は「今この瞬間」の感知にある。「Data Streaming Platform」で実現する「AI Ready Data」を解説

-

-

-

-

VDIの導入コストを抑制! コストコンシャスなエンタープライズクラスの仮想デスクトップ「Parallels RAS」とは

-

AI時代の“基幹インフラ”へ──NEC・NOT A HOTEL・DeNAが語るZoomを核にしたコミュニケーション変革とAI活用法

-

加速するZoomの進化、エージェント型AIでコミュニケーションの全領域を変革─「Zoom主催リアルイベント Zoomtopia On the Road Japan」レポート

-

14年ぶりに到来したチャンスをどう活かす?企業価値向上とセキュリティ強化・運用効率化をもたらす自社だけの“ドメイン”とは

-

-

-

-

生成AIからAgentic AIへ―HCLSoftware CRO Rajiv Shesh氏に聞く、企業価値創造の課題に応える「X-D-Oフレームワーク」

-

-

-

「プラグアンドゲイン・アプローチ」がプロセス変革のゲームチェンジャー。業務プロセスの持続的な改善を後押しする「SAP Signavio」

-

BPMとプロセスマイニングで継続的なプロセス改善を行う仕組みを構築、NTTデータ イントラマートがすすめる変革のアプローチ

-